該相信人工智能還是人類直覺

策 略

位于香港的投資公司Deep Knowledge Ventures在2014年因?yàn)樵诙聲胗?jì)算機(jī)算法而聲名大振,。該公司旗下管理的資產(chǎn)約為1億歐元,,希望找到一種方法來實(shí)施數(shù)據(jù)驅(qū)動型的投資策略,而不是依靠人類的直覺以及與創(chuàng)始人之間的關(guān)系。執(zhí)行合伙人德米特里·卡明斯基(Dmitry Kaminskiy)表示,該算法大多用來行使否決權(quán),,如果它發(fā)現(xiàn)危險(xiǎn)信號,Deep Knowledge就不會投資,。

自從Deep Knowledge的人工智能技術(shù)參與董事會五年來,,市場上并沒有出現(xiàn)多少真正意義上的效仿者,。事實(shí)上,,Deep Knowledge自身也已經(jīng)轉(zhuǎn)移其精力,而且不再使用這一算法,。美國西北大學(xué)(Northwestern University)凱洛格管理學(xué)院(Kellogg School of Management)的教授布萊恩·烏茲(Brian Uzzi)說:“如今,,重大策略決策基于直覺”—也就是說,由人來制定—“因?yàn)槲覀內(nèi)狈ο嚓P(guān)數(shù)據(jù),?!睂?shí)際上,各大公司所做重大決策的數(shù)量還不足以用來有效地培訓(xùn)算法,。

然而,,隨著我們搜集更多的數(shù)據(jù)或解決數(shù)據(jù)缺乏問題的模型獲得商業(yè)市場的青睞,人工智能承擔(dān)更多的策略性職責(zé)只是遲早的事情,,包括就開展哪些并購交易提供洞見,,進(jìn)駐哪個地域,是否推出與競爭者類似的產(chǎn)品,。

這一現(xiàn)象在一定程度上也引發(fā)了一些反對聲音,。一些管理大拿和理論學(xué)家則突然一反常態(tài)地阻礙人工智能發(fā)展,并借此遏制人工智能趨勢:他們斷然告訴公司的董事會,,不要拋棄人類直覺和常識,。

今年年初,英國卡迪夫大學(xué)(Cardiff University)的德克·林德鮑姆(Dirk Lindebaum)與位于赫爾辛基(Helsinki)的漢肯經(jīng)濟(jì)學(xué)院(Hanken School of Economics)的米科·韋薩(Mikko Vesa)和弗蘭克·登宏德(Frank den Hond)撰寫了一篇挑釁性的文章,,警告公司董事不要過分迷戀人工智能,。為了證明其觀點(diǎn),這三位學(xué)者將其與經(jīng)典的愛德華·摩根·福斯特

(E.M. Forster)的科幻故事《機(jī)器停了》(The Machine Stops)進(jìn)行了比較。在該故事中,,人類因?yàn)檫^分依賴于全能機(jī)器而失去了獨(dú)立思考和行動的能力,。林德鮑姆對

《財(cái)富》雜志說:“我們放棄了越來越多的自主掌控權(quán)。最終的情形是,,人們實(shí)際上已經(jīng)沒有選擇,,并成為了算法盲目的追隨者?!?/p>

包括林德鮑姆在內(nèi)的評論員提到了兩架波音(Boeing)737 Max 8機(jī)型的墜毀事件,,將其自動駕駛系統(tǒng)問題稱之為警世之鐘。駕駛員對該系統(tǒng)并不完全了解,,而且沒有辦法輕易地判斷,,飛機(jī)是否基于錯誤的感應(yīng)器數(shù)據(jù)而做出了決定。這類“自動化驚喜”是人工智能尤為突出的問題,,因?yàn)楫?dāng)今眾多強(qiáng)大的機(jī)器學(xué)習(xí)算法都是黑盒子,。我們并不知道它們?yōu)槭裁磿龀瞿愁愵A(yù)測,即便是它的編程人員也搞不懂,。

在生死攸關(guān)的局面中,,例如飛機(jī)自動駕駛或自動駕駛汽車,林德鮑姆的建議還是非常在理的,。然而在商業(yè)策略領(lǐng)域中,,經(jīng)理們?nèi)绻粚W(xué)會信任他們所采用的算法,他們是否會錯失黃金洞見,。

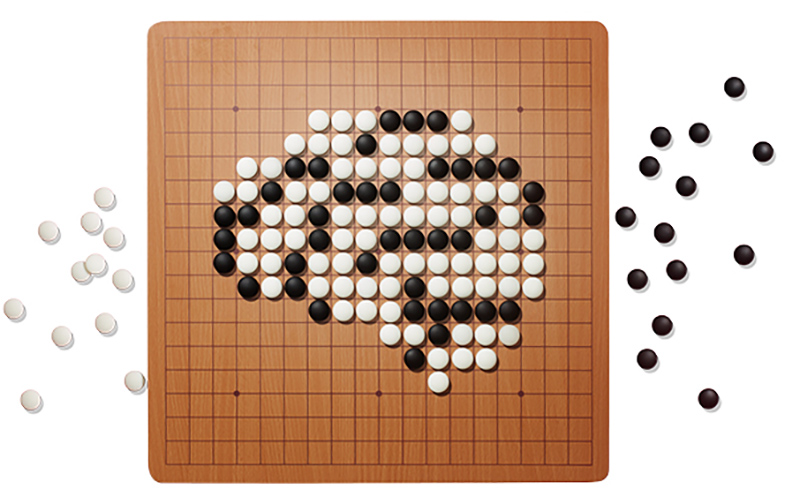

不妨看看在2016年古老的策略游戲圍棋中,,世界級選手李世石(Lee Sedol)與Alphabet旗下的人工智能公司DeepMind打造的AlphaGo算法之間的對弈。在第二局的第37步,,AlphaGo走出了一步十分詭異的棋,,一開始,評論這場比賽的圍棋專家認(rèn)為負(fù)責(zé)替AlphaGo在棋盤上走棋的人犯了一個錯誤,。根據(jù)AlphaGo自身的評估,,人類棋手在該棋局中走這一步的概率為萬分之一。然而,,甚至連DeepMind的研究人員都感到疑惑不解的是,,AlphaGo竟然把這步棋看作是一個制勝招數(shù)。(接下來AlphaGo確實(shí)贏了這盤棋,。)

有鑒于這種“怪異”的洞見,,新興的管理層觀點(diǎn)—不要拋棄常識或人類經(jīng)驗(yàn)—看似完全站不住腳。如果按照這個觀點(diǎn)行事,,人們就不會走第37步棋,。另一方面,董事會如何去區(qū)分第37步棋和波音737墜機(jī)之間的區(qū)別。

解決這一緊張的局勢并不是一件容易的事情,。教授人工智能課程的紐約大學(xué)(New York University)的商學(xué)教授羅伯特·西曼斯(Robert Seamans)指出,,這也是為什么經(jīng)理們對人工智能系統(tǒng)工作原理的理解如此重要的原因。它并非只是制定“正確”的策略決定,,還涉及執(zhí)行,。他表示,理解決策背后的邏輯對獲得實(shí)施這一決策的認(rèn)同(來自于雇員和投資者)至關(guān)重要,。他說:“這并非只是列出概率性的結(jié)果,,公司的每個人都得接受這種做法。如果你無法解釋清楚其緣由,,也就難以實(shí)施這一決策,。”領(lǐng)導(dǎo)力并非只是決策那么簡單,,它還包括說服他人接受自己的觀點(diǎn),。

譯者:馮豐

-

熱讀文章

-

熱門視頻